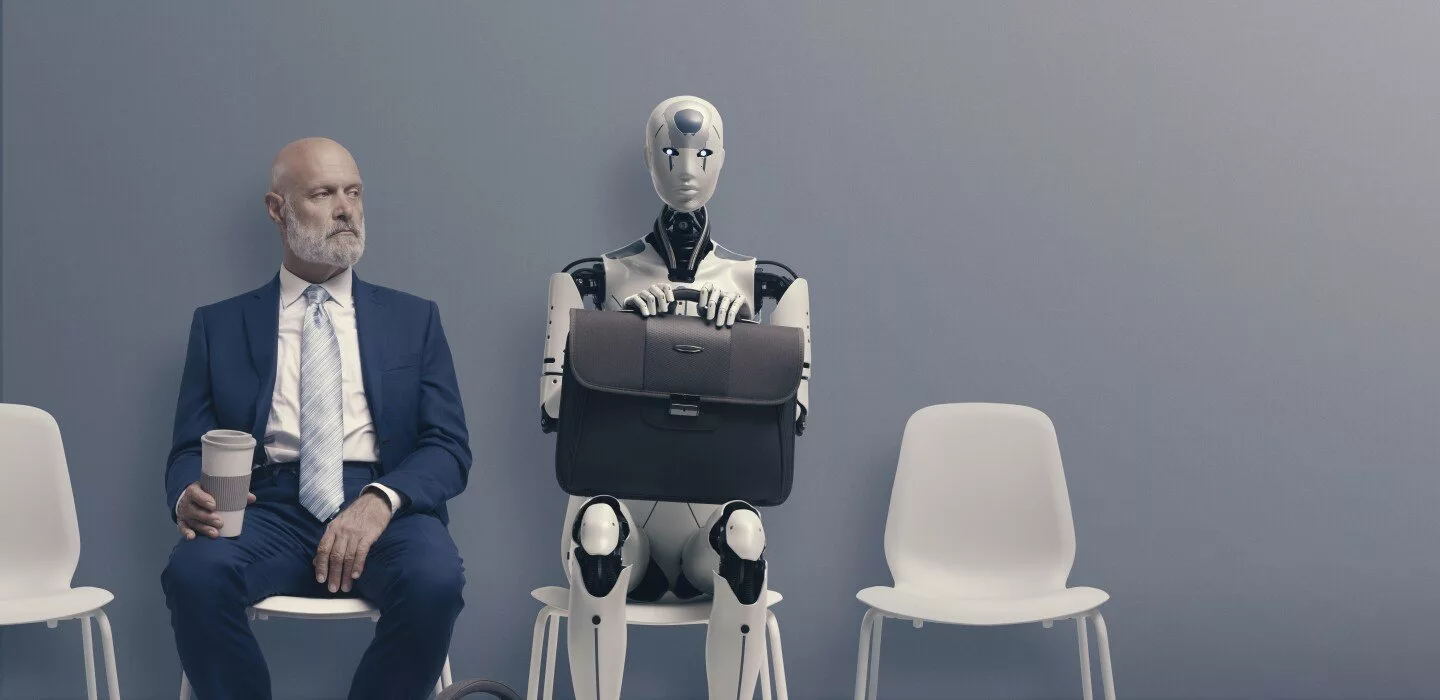

دانشجویان دارای اختلالات روانی و خودشیفتگی به شکل بیشتری از هوش مصنوعی بهرهبرداری مینمایند

تحقیقات تازهای نشاندهنده وجود ارتباط معناداری بین ویژگیهای شخصیتی «تاریک» نظیر خودشیفتگی، روانآزاری و ماکیاولیسم با افزایش استفاده از ابزارهای هوش مصنوعی مولد مانند ChatGPT در راستای انجام تکالیف دانشگاهی است.

بر اساس اطلاعات منتشر شده توسط Futurism، این مطالعه به تحلیل جنبههای تاریکتر هوش مصنوعی پرداخته و به بررسی این موضوع میپردازد که چه افرادی بیشتر از این فناوری برای تقلب و فرار از مسئولیتهای تحصیلی بهره میبرند. گروهی از روانشناسان در کره جنوبی، با نظرسنجی از ۵۰۴ دانشجوی هنر در چین، به نتایج دلنگرانی دست یافتهاند.

سوءاستفاده دانشجویان از هوش مصنوعی

این تحقیق بر مبنای مدل روانشناختی «سهگانه تاریک» (Dark Triad) شکل گرفته است، که سه ویژگی منفی شخصیتی را ارزیابی میکند:

- خودشیفتگی (Narcissism): گرایش به بزرگنمایی خویش و نیاز مداوم به تحسین.

- ماکیاولیسم (Machiavellianism): تمایل به فریب دیگران و سوءاستفاده از آنها به منظور دستیابی به اهداف شخصی.

- روانآزاری (Psychopathy): نبود همدلی و رفتارهای ضد اجتماعی.

نتایج این تحقیق به وضوح نشان داد که دانشجویانی که در این سه ویژگی نمرات بالاتری کسب کرده بودند، بهطرز قابلتوجهی بیشتر از ابزارهایی همچون ChatGPT و Midjourney برای تکالیف خود بهره میبرند و سعی میکنند آثار تولید شده توسط هوش مصنوعی را بهعنوان کار خود ارائه نمایند.

مطالعه همچنین به شناسایی یک مکانیزم روانشناختی برای این رفتار پرداخت. یافتهها حاکی از آن است که این ویژگیهای شخصیتی تاریک، با اضطراب تحصیلی بالاتر و تمایل بیشتر به اهمالکاری ارتباط دارند. این اضطراب و تعویق در انجام کارها، در نهایت افراد را به سمت استفاده از هوش مصنوعی بهعنوان راهی سریع و فرار از مسئولیت سوق میدهد.

افزون بر این، یک عامل دیگر نیز شناسایی گردید: مادیگرایی. دانشجویانی که بیشتر به دنبال دریافت پاداشها و تحسینهای خارجی هستند، تمایل بیشتری به استفاده از هوش مصنوعی برای دستیابی به این اهداف دارند.

نویسندگان این پژوهش، استفاده از هوش مصنوعی برای تقلب را نوعی «سوءرفتار تحصیلی» مشابه با دروغگویی و سرقت ادبی تلقی کرده و برای رویارویی با این مشکل، راهکارهایی به مؤسسات و دانشگاهها پیشنهاد میدهند:

- بازطراحی برنامههای درسی: ایجاد تکالیف و پروژههایی که «کمتر در معرض سرقت ادبی» و تقلید از سوی هوش مصنوعی قرار داشته باشند.

- آموزش اخلاق هوش مصنوعی: مدارس و دانشگاهها باید بهطور جدی دانشجویان را در مورد «خطرات و چالشهای اخلاقی» مربوط به این فناوری آگاه سازند.

- ارائه حمایتهای روانشناختی: با توجه به ارتباط این رفتار با اضطراب و مسائل روانی، فراهمآوری خدمات مشاورهای و حمایتهای روانی برای دانشجویان میتواند به کاهش این پدیده کمک کند.

یافتههای این پژوهش در نشریه BMC Psychology منتشر شده است. علاوه بر این، محققان در تحقیق دیگری به این نتیجه رسیدند که ۱۴ درصد از مقالات علمی دارای نشانههایی از استفاده از هوش مصنوعی هستند.